23/01/2025 13:52

23/01/2025 13:52

23/01/2025 13:51

23/01/2025 13:51

23/01/2025 13:50

23/01/2025 13:50

23/01/2025 13:50

23/01/2025 13:49

23/01/2025 13:49

23/01/2025 13:48

» Diario Cordoba

Fecha: 23/01/2025 08:37

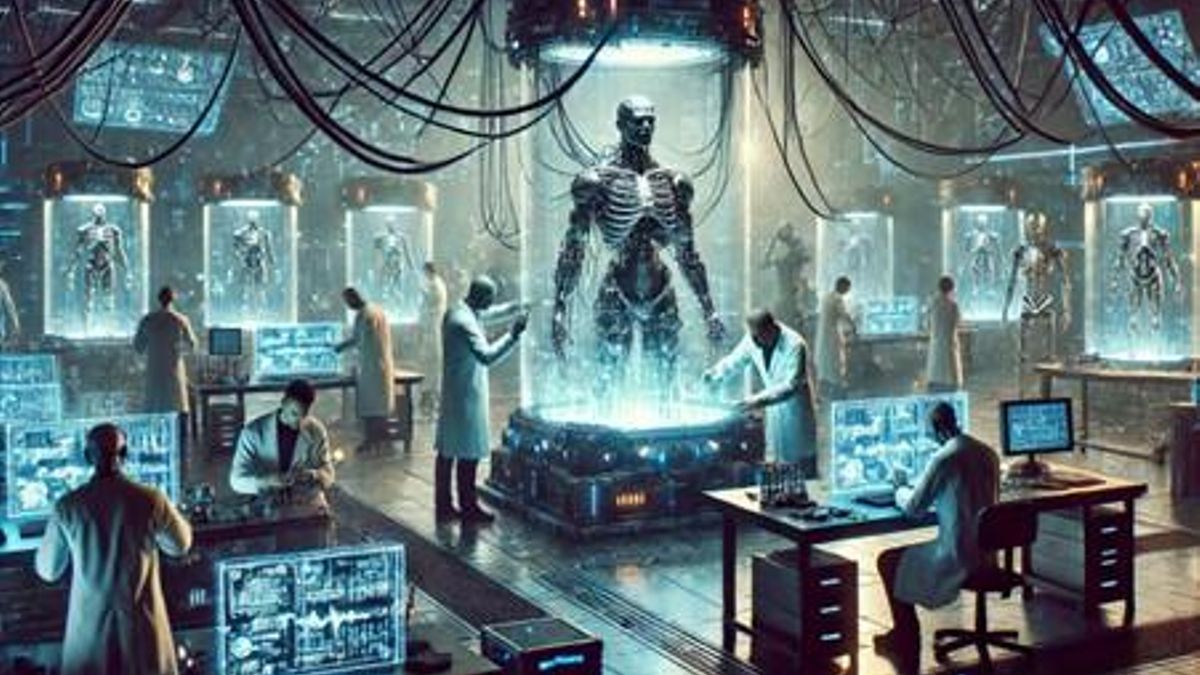

Imagen de recurso / Créditos de la imagen (ChatGPT 4o, OpenAI), prompt Xabi Uribe-Etxebarria “Que el Congreso (de los Estados Unidos) establezca y financie un programa similar al Proyecto Manhattan, con el objetivo de competir y lograr capacidad de Inteligencia General Artificial (AGI).” Esta es la recomendación que propuso el informe de la comisión económica y de seguridad Estados Unidos - China al Congreso de los Estados Unidos en noviembre de 2024. Añadía también que se deben otorgar los recursos necesarios a las empresas que están desarrollando la Inteligencia Artificial, computación en la nube y otras infraestructuras con el fin de conseguir el objetivo de liderazgo de los Estados Unidos en la AGI. Además, pedía otorgar la “calificación DX” (Defense Priorities and Allocations System) para garantizar que el ecosistema de la Inteligencia Artificial reciba prioridad nacional. Ayer, en una comparecencia en la Casa Blanca y en su primer día de mandato, Donald Trump, junto con Larry Ellison (Oracle), Sam Altman (OpenAI) y Masayoshi Son (SoftBank) se presentó este nuevo “proyecto Manhattan” con el nombre de “Stargate”. Esta nueva empresa invertirá 500.000 millones de dólares y afirman que permitirá crear cientos de miles de empleos. Todo para asegurar la supremacía de los Estados Unidos en Inteligencia Artificial y con el objetivo de lograr la tan ansiada AGI además de otros objetivos como apoyar la re-industrialización y proveer de capacidades estrategicas en materia de Seguridad Nacional a los Estados Unidos de América y a sus aliados tal como indica el comunicado de OpenAI en X. ¿Pero qué es la AGI y por qué es tan importante? Desde hace tiempo, la IA ya es capaz de realizar ciertas tareas cognitivas mejor de lo que lo haría el humano más capacitado para realizar esa tarea concreta. Jugar a juegos como el ajedrez, traducir textos, detectar cánceres en radiografías o tomografías donde el ojo humano no puede ver, son algunos ejemplos. Esto es lo que llamamos “Narrow artificial intelligence” o inteligencia artificial “Débil” y cada tarea; jugar al ajedrez, detectar anomalías en imágenes o conducción autónoma requieren de algoritmos diferentes o al menos requieren de un entrenamiento diferente para cada uno de esos algoritmos. Dicho de otra manera, si quisiéramos que un modelo de IA débil que sabe jugar al ajedrez mejor que el campeón mundial, conduzca un coche de manera autónoma, traduzca un texto o detecte cánceres en radiografías, sería imposible. Están preparados para hacer una sola tarea. En definitiva, la IA débil, no son algoritmos generalistas o no pueden hacer tareas diferentes al propósito para el que han sido entrenados. Sin embargo, con el cerebro humano no ocurre lo mismo. A un niño, le podemos enseñar a jugar al ajedrez y a ese mismo niño le podemos enseñar a hablar un idioma, a localizar animales en imágenes, a andar o a conducir un vehículo y aprenderá sin dificultad. El cerebro humano es una máquina preparada para aprender infinidad de tareas. Es generalista o al menos, aunque (el cerebro) tenga partes diferenciadas, está orquestado para funcionar como un único órgano generalista. Si pudiéramos hacer eso con una máquina, habríamos alcanzado lo que llamamos Inteligencia Artificial General, AGI. Hasta la aparición de una nueva arquitectura de redes neuronales artificiales, las redes de tipo “transformer” (que da nombre a la T” de GPT) y con ellas, los llamados grandes modelos de lenguaje (LLM) basados en estas grandes redes neuronales artificiales, se pensaba que la AGI llegaría más allá del 2045 pero hoy en día ese punto está tan cercano como difuso. Incluso que gracias al avance tecnológico de estos grandes modelos de lenguaje (LLMs) hemos alcanzado ya algún grado de “generalidad” en la IA y con los nuevos modelos “razonadores” como o3 anunciados hace unas semanas por OpenAI, aún más. Las herramientas El Sapiens, nuestra especie, no contento con sus capacidades biológicas, durante toda la historia de la humanidad ha creado tecnología para tratar de mejorarse. Creando herramientas que nos aumentan tanto física como intelectualmente y así ampliar aún más nuestra ventaja frente al resto de especies de animales. Creamos hachas o cuchillos de silex como extensión de nuestros dientes. Arcos, flechas y ondas como extensión de nuestros brazos y así poder lanzar piedras, más fuerte y más lejos. Creamos carros tirados por animales y más tarde por motores de combustión como extensión de nuestras piernas y así poder transportarnos más rápido y más lejos. Las herramientas están íntimamente ligadas a nuestro físico, hasta tal punto de que han contribuido en nuestro cambio físico. Un ejemplo es la domesticación del fuego y la evolución de nuestro sistema digestivo. Pero no nos hemos conformado con querer mejorar nuestras capacidades físicas, también hemos querido aumentar nuestras capacidades cognitivas. Creamos la escritura, como extensión de nuestra memoria y capacidad de comunicación. Creamos las matemáticas para explicar el universo que nos rodea y en combinación con la escritura también para ser capaces de hacer cálculos más complejos y precisos. Milenios más tarde, creamos las máquinas de cómputo y los ordenadores como extensión de nuestra capacidad de razonamiento y así con infinidad de avances tecnológicos que consiguen superar nuestras limitaciones cognitivas, hasta que finalmente creamos la Inteligencia Artificial. La AGI no es una herramienta Un martillo o una llave inglesa son herramientas, incluso algo tan potente como una bomba atómica, pero ninguno de estos inventos tiene agencia, es decir, no tiene la capacidad de tomar decisiones. La agencia está en quien las crea o en quien las utiliza. Los humanos y en mi opinión, los animales, al menos con cierto grado. Las aplicaciones de IA débil, como un sistema de reconocimiento de voz o un sistema que detecte cánceres en imágenes también son herramientas. Y al igual que un destornillador o un taladro están hechas para un propósito concreto y por tanto no tiene agencia o entidad propia. Pero la AGI es un invento muy diferente. Esta vez no estamos creando una simple herramienta que nos aumenta como muchos afirman, sino un ente con agencia, con capacidad de tomar decisiones, con entidad en sí misma. Algo así como crear vida propia. Metafóricamente sería algo así como la Abiogénesis de la AGI, término que utilizan los biólogos para describir (en una de las teorías) ese momento en que se creó vida a partir de materia inerte. Pero esta vez, la nueva especie “inteligente”, no nace fruto de la evolución biológica, sino de la evolución tecnológica, en definitiva, de nuestra propia “inteligencia”. La era agéntica Entramos en 2025 inmersos en la AGI y con los primeros brotes de la era agéntica. Una nueva era en la que pronto los agentes inteligentes superarán a los humanos tanto en inteligencia como en número. Es decir, en muy poco tiempo habrá más agentes de IA que personas en la tierra. La Super-Inteligencia Artificial El informe al congreso define la AGI como sistemas que igualan o superan las capacidades humanas en todos los dominios cognitivos y que superarían a las mentes humanas más capacitados para cada tarea. Como en esta, en muchas definiciones se está subiendo el listón, y en mi opinión, esta definición estaría más cerca del concepto que hoy se denomina Superinteligencia Artificial (ASI) que comúnmente se refiere a una inteligencia muy por encima de genios y de las mentes humanas más dotadas. Pero sea como fuere la nomenclatura correcta, ese punto al que hace referencia esta nueva definición está a la vuelta de la esquina. Tanto Sam Altman (CEO de OpenAI) como Elon Musk o el recientemente galardonado con el Premio Nobel de Física Geoffrey Hinton coinciden en que llegará antes de final de la década y alguno incluso afirma que podría llegar este mismo año. Lograrlo proporcionará una ventaja bestial a la o las potencias que lo consigan. Y aunque habrá diferentes enfoques y especializaciones en esa carrera, esa ventaja se trasladará a muchos ámbitos de nuestras vidas. Imaginaos poder disponer de un ejército casi ilimitado de científicos más inteligentes que Marie Curie o Einstein, capaces de descubrir nuevos materiales o nuevas fuentes de energía limpia. O disponer de los mejores investigadores capaces de descubrir tratamientos a enfermedades hasta ahora incurables o incluso de revertir el envejecimiento. Imaginaos que gran parte de la capacidad productiva esté gestionada por inteligencias artificiales y que, por tanto, el trabajo se convierta en opcional. Estos son unos pocos ejemplos de lo que la ASI puede impactar en nuestra economía, en nuestra vida y en definitiva, en el conjunto de la humanidad. La carrera hacia la Super-Inteligencia Artificial se ha convertido en una prioridad geopolítica. Estados Unidos y China están a la cabeza de este objetivo tecnológico. Por desgracia, Europa está perdiendo este tren, pero aún estamos a tiempo.

Ver noticia original