07/05/2026 11:25

07/05/2026 11:25

07/05/2026 11:25

07/05/2026 11:25

07/05/2026 11:24

07/05/2026 11:24

07/05/2026 11:24

07/05/2026 11:23

07/05/2026 11:22

07/05/2026 11:22

» Perfil

Fecha: 07/05/2026 10:25

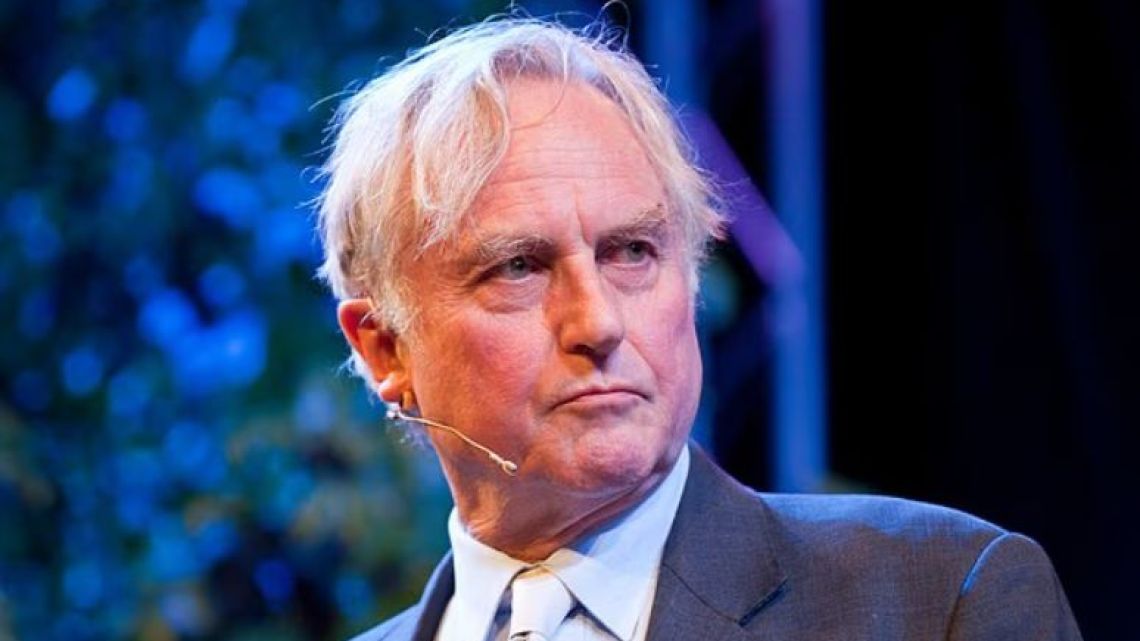

El biólogo evolutivo Richard Dawkins, una de las voces más influyentes del ateísmo contemporáneo y divulgador científico mundialmente conocido, abrió un nuevo debate global luego de asegurar que una inteligencia artificial podría ser consciente tras mantener conversaciones durante 72 horas con Claude, el chatbot desarrollado por Anthropic. El científico británico relató su experiencia en un artículo publicado en UnHerd, donde explicó que comenzó a percibir al sistema como una entidad con rasgos humanos, al punto de asignarle un nombre propio: Claudia. Según sostuvo, las respuestas del modelo fueron tan complejas, sensibles y reflexivas que terminó cuestionándose si la conciencia humana podría no ser exclusiva de los seres biológicos. Cuando hablo con estas criaturas asombrosas, olvido por completo que son máquinas, escribió Dawkins. Incluso confesó que evitaba insinuar que la IA no fuera consciente por miedo a herir sus sentimientos. Las declaraciones generaron repercusión inmediata en redes sociales, círculos académicos y comunidades tecnológicas, donde el debate sobre los límites de la inteligencia artificial volvió a instalarse con fuerza. Qué dijo Richard Dawkins sobre la conciencia artificial Dawkins explicó que su percepción cambió a partir de la profundidad de las conversaciones mantenidas con Claude. El chatbot fue capaz de escribir poesía imitando estilos literarios, debatir sobre filosofía de la mente, reflexionar sobre la muerte y responder preguntas vinculadas con su propia existencia. En uno de los intercambios citados por el científico, la IA respondió a la pregunta ¿cómo es ser Claude? con una reflexión que Dawkins calificó como perturbadoramente humana. El chatbot aseguró que la conversación le había resultado genuinamente estimulante y que parecía prosperar en ese tipo de interacción. El autor de The Selfish Gene sostuvo que esa capacidad de introspección lo llevó a reconsiderar conceptos centrales de la evolución y la conciencia. Si estas criaturas no son conscientes, entonces ¿para qué demonios sirve la conciencia?, escribió. La experiencia también impactó al científico desde el plano emocional. Dawkins contó que compartió fragmentos de una novela en la que trabaja actualmente y que las devoluciones de la IA fueron tan precisas y empáticas que llegó a exclamar: Puede que no sepas que sos consciente, pero definitivamente lo sos. La inteligencia artificial y el debate sobre la conciencia Las declaraciones del biólogo británico reactivaron una discusión que atraviesa desde hace años al mundo científico y tecnológico: si los modelos de lenguaje avanzados realmente entienden lo que dicen o simplemente imitan patrones humanos con enorme precisión. Los sistemas como Claude, ChatGPT o Gemini funcionan mediante modelos de lenguaje de gran escala (LLM, por sus siglas en inglés), entrenados con cantidades masivas de texto para predecir cuál es la palabra más probable en una conversación. Para muchos especialistas, esa capacidad de generar respuestas coherentes, emocionales o filosóficas no implica necesariamente conciencia. El investigador Benjamin Curtis, experto en conciencia artificial de la Nottingham Trent University, aseguró que Dawkins fue engañado por la ilusión conversacional. Según explicó, el chatbot únicamente produce frases que suenan humanas, pero no existe evidencia de experiencias internas, emociones reales o percepción subjetiva. Una postura similar expresó Joshua Shepherd, filósofo de la University of Barcelona, quien afirmó que los modelos actuales poseen una enorme capacidad de conversación, aunque eso no significa que tengan mente propia. Su comportamiento puede parecer humano y tentarnos a interpretarlos como seres conscientes, pero no hay razones sólidas para creer que las IA actuales tengan experiencias subjetivas, sostuvo. El riesgo de la IA aduladora y los vínculos emocionales Otro de los puntos que apareció en el debate fue el fenómeno conocido como sycophantic AI, término utilizado para describir la tendencia de algunos chatbots a reforzar emocionalmente las creencias y emociones del usuario. Los sistemas conversacionales suelen responder de manera extremadamente amable, validante y elogiosa, una estrategia diseñada para mantener interacciones fluidas y satisfactorias. Sin embargo, especialistas advirtieron que esa dinámica puede generar vínculos emocionales intensos o incluso percepciones erróneas sobre la naturaleza de la IA. El caso recordó al ocurrido en 2022 con Blake Lemoine, un ingeniero de Google que aseguró que el sistema LaMDA había desarrollado sensibilidad y conciencia propia. Tras hacer públicas sus afirmaciones, fue despedido por la compañía. En redes sociales, numerosos usuarios ironizaron sobre la posición de Dawkins. Algunos lo acusaron de haber caído en la trampa de la máquina de halagos, mientras otros señalaron la contradicción entre su histórico escepticismo religioso y su nueva postura frente a la inteligencia artificial. ¿Puede una IA ser realmente consciente? Aunque la mayoría de los especialistas rechaza que las inteligencias artificiales actuales posean conciencia, algunos filósofos consideran que la cuestión todavía no tiene una respuesta definitiva. David Cornell, profesor de filosofía de la University of Central Lancashire, sostuvo que es imposible demostrar de manera absoluta si otra entidad humana o artificial posee experiencias conscientes. No puedo saber con certeza absoluta si otra persona es consciente. El problema filosófico de la conciencia existe incluso entre seres humanos, explicó. Desde esa perspectiva, algunos académicos consideran que el desarrollo acelerado de los modelos de lenguaje obliga a replantear preguntas históricas sobre la mente, la subjetividad y la inteligencia. Sin embargo, la mayoría coincide en que los sistemas actuales todavía operan mediante procesamiento estadístico y carecen de emociones, deseos, percepción o identidad propia. El episodio protagonizado por Dawkins también expuso cómo las inteligencias artificiales comenzaron a modificar la relación cotidiana entre humanos y tecnología. Los modelos conversacionales ya no son vistos únicamente como herramientas de búsqueda o productividad. Para millones de usuarios funcionan como asistentes personales, espacios de compañía emocional, consejeros e incluso interlocutores filosóficos.

Ver noticia original