21/04/2026 23:31

21/04/2026 23:27

21/04/2026 23:26

21/04/2026 23:26

21/04/2026 23:20

21/04/2026 23:20

21/04/2026 23:20

21/04/2026 23:20

21/04/2026 23:20

21/04/2026 23:20

» La Nacion

Fecha: 21/04/2026 21:52

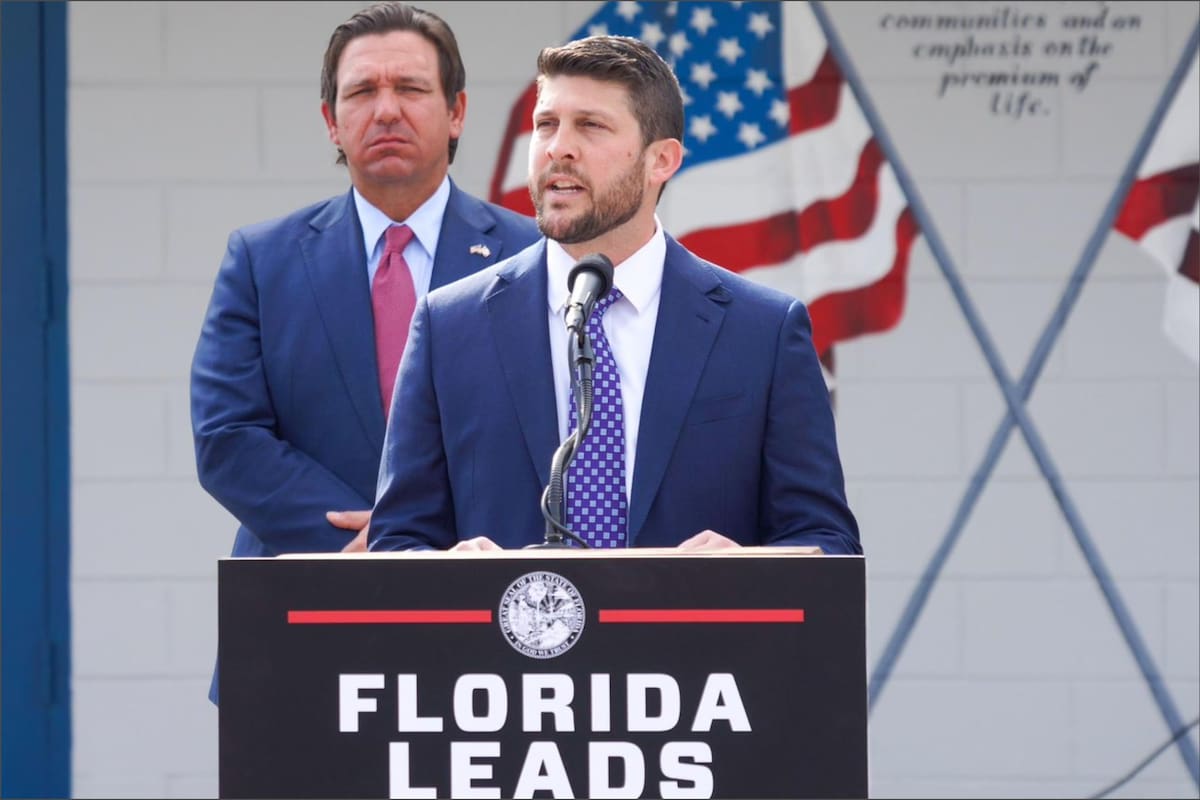

Florida abre una investigación criminal contra OpenAI por el rol de ChatGPT en un tiroteo en una universidad El fiscal general detalló la conversación en la que el chatbot recomienda al tirador la mejor manera de efectuar el ataque: Si hubiera sido una persona al otro lado de la pantalla, la acusaríamos de asesinato - 5 minutos de lectura' MIAMI.- Las autoridades de Florida anunciaron este martes que iniciaron una investigación criminal contra la empresa de inteligencia artificial OpenAI, en relación con un tiroteo que dejó dos muertos en una universidad el año pasado. El fiscal general de Florida, James Uthmeier, hizo el anuncio en una conferencia de prensa en Tampa. El fiscal explicó que las conversaciones entre el sospechoso y ChatGPT, el chatbot de la compañía, indican que el sistema le sugirió al tirador qué tipo de arma o qué municiones utilizar, si el ataque debía realizarse a corta distancia, en qué momento del día el lugar estaría más concurrido y en qué zonas del campus podría encontrar una mayor concentración de personas. ChatGPT ofreció asesoramiento significativo al atacante antes de que cometiera estos crímenes atroces, dijo Uthmeier. Si hubiera sido una persona al otro lado de la pantalla, la acusaríamos de asesinato. Por supuesto, ChatGPT no es una persona, pero eso no exime a nuestra oficina ni a mi equipo de fiscales de la obligación de investigar si existe responsabilidad penal por parte de una corporación, agregó. En abril del año pasado, un estudiante de la Universidad Estatal de Florida (FSU), en Tallahassee, al norte de la península, abrió fuego cerca del sindicato estudiantil, matando a dos personas e hiriendo a seis, entre ellos varios estudiantes. El sospechoso, Phenix Ikner, entonces de 20 años, enfrenta varios cargos de asesinato. Un vocero de OpenAI dijo a EL PAÍS que el tiroteo en FSU fue una tragedia, pero ChatGPT no es responsable de este terrible crimen. Tras conocer el incidente, identificamos una cuenta de ChatGPT que se cree estaba asociada con el sospechoso y compartimos proactivamente esta información con las autoridades. Seguimos cooperando con ellas. En este caso, ChatGPT proporcionó respuestas factuales a preguntas con información que puede encontrarse ampliamente en fuentes públicas en internet, y no alentó ni promovió ninguna actividad ilegal o dañina. ChatGPT es una herramienta de uso general utilizada por cientos de millones de personas cada día con fines legítimos. Trabajamos continuamente para fortalecer nuestras salvaguardas con el fin de detectar intenciones dañinas, limitar el uso indebido y responder adecuadamente cuando surgen riesgos para la seguridad. Uthmeier dijo que el Estado ya presentó cargos en crímenes relacionados con imágenes de pornografía infantil generadas con IA. El fiscal recordó que la legislatura estatal aprobó el mes pasado una nueva ley que aumenta significativamente las penas por delitos sexuales contra menores, incluyendo la creación de material de abuso sexual infantil generado por IA. El anuncio se produce en un contexto más amplio de impulso regulatorio en Florida sobre la inteligencia artificial, en medio de una creciente tensión entre el Gobierno federal y los Estados individuales sobre quién debe regular esta tecnología. El gobernador de Florida, Ron DeSantis, incluyó en una sesión especial programada para fines de mes un proyecto de ley llamado Carta de Derechos de la Inteligencia Artificial. Esta funcionaría como una especie de salvaguardas frente a los riesgos de estas tecnologías e incluiría protección de datos y mecanismos legales frente a abusos. La Carta fue aprobada por el Senado de Florida con 35 votos a favor y dos en contra como el proyecto SB 482, pero no avanzó en la Cámara de Representantes. El proyecto incorpora ciertas salvaguardas para personas consideradas vulnerables porque podrían confundirse con la tecnología, como menores de edad, adultos mayores y personas con dificultades cognitivas, que pueden ser más susceptibles a la manipulación. El proyecto aborda los actuales desafíos de transparencia para los consumidores, las amenazas a la seguridad infantil y otros posibles impactos derivados de los avances tecnológicos en inteligencia artificial, escribió el presidente del Senado, Ben Albritton, en un memorando en el que anuncia la sesión especial. Ante la ausencia de una legislación federal integral, los Estados avanzaron con un creciente mosaico de regulaciones sobre inteligencia artificial, con más de 1500 iniciativas en lo que va de 2026. California, Texas y Colorado adoptaron leyes enfocadas en transparencia, ética y sistemas de alto riesgo como los utilizados en empleo o vivienda. Utah, Illinois, Washington, Oregón e Idaho, entre otros, implementaron medidas que regulan desde entrevistas laborales hasta estándares educativos, entre otras actividades. Sin embargo, la administración de Donald Trump advirtió que un mosaico de leyes estatales podría frenar la innovación. El mes pasado, la Casa Blanca presentó un plan llamado Marco Legislativo Nacional de Inteligencia Artificial, que buscaba crear una hoja de ruta para una legislación federal de la IA. © Derechos mundiales de prensa en todas las lenguas reservados a Ediciones EL PAÍS, S.L.U.

Ver noticia original